System binarny jest podstawą działania komputerów, ponieważ jego prostota jest niezawodna

- System binarny używa tylko dwóch cyfr: 0 i 1, nazywanych bitami.

- Komputery wykorzystują go, ponieważ stany 0 i 1 można łatwo przedstawić fizycznie jako "brak napięcia" i "obecność napięcia".

- Miniaturowe przełączniki zwane tranzystorami w procesorze fizycznie realizują te stany włącz/wyłącz.

- Wszystkie dane liczby, tekst, obrazy, a nawet dźwięk są w komputerze zamieniane na ciągi zer i jedynek.

- Osiem bitów tworzy jeden bajt, który jest podstawową jednostką informacji w pamięci komputera.

Dlaczego twój komputer myśli tylko dwiema cyframi, czyli wprowadzenie do binarnego świata

Język zer i jedynek: czym jest system binarny?

Zacznijmy od podstaw. System binarny, znany również jako system dwójkowy, to pozycyjny system liczbowy, którego podstawą jest liczba 2. Oznacza to, że do zapisu wszelkich informacji używa on wyłącznie dwóch symboli: 0 i 1. Te proste cyfry, nazywane bitami (od angielskiego "binary digit"), stanowią uniwersalny język, który rozumieją wszystkie współczesne urządzenia cyfrowe. To właśnie w tej prostocie tkwi jego potęga pozwala on na jednoznaczną reprezentację danych, niezależnie od ich złożoności.Od atomu informacji do konkretu: co to jest bit i bajt?

W świecie cyfrowym, najmniejszą, atomową jednostką informacji jest właśnie bit. Możemy myśleć o nim jak o pojedynczym przełączniku, który może być w jednym z dwóch stanów: włączony (1) lub wyłączony (0). To absolutne minimum, z którego budowany jest cały cyfrowy wszechświat. Idąc dalej, osiem bitów tworzy bajt. Bajt jest podstawową jednostką adresowalną pamięci w większości komputerów, co oznacza, że komputer odwołuje się do danych w blokach po osiem bitów. Dzięki temu, że jeden bajt składa się z ośmiu bitów, może on reprezentować aż 2 do potęgi ósmej, czyli 256 różnych wartości. To wystarczająco dużo, aby zakodować na przykład wszystkie litery alfabetu, cyfry i podstawowe symbole interpunkcyjne.

Klucz do cyfrowej rewolucji, czyli dlaczego komputery używają systemu binarnego

Prostota i niezawodność: jak stany napięcia (włącz/wyłącz) stały się alfabetem technologii

Głównym powodem, dla którego komputery opierają się na systemie binarnym, jest jego niezrównana prostota i niezawodność w implementacji technicznej. Wyobraź sobie, że musisz stworzyć maszynę, która rozróżnia wiele różnych sygnałów. Im więcej sygnałów, tym większe ryzyko pomyłki. System binarny eliminuje ten problem, sprowadzając wszystko do dwóch, łatwo rozróżnialnych stanów fizycznych: obecności napięcia elektrycznego (co interpretujemy jako 1) i jego braku (interpretowanego jako 0). Ta binarna natura sprawia, że system jest niezwykle odporny na zakłócenia i błędy, co jest kluczowe dla stabilnego działania złożonych systemów komputerowych.

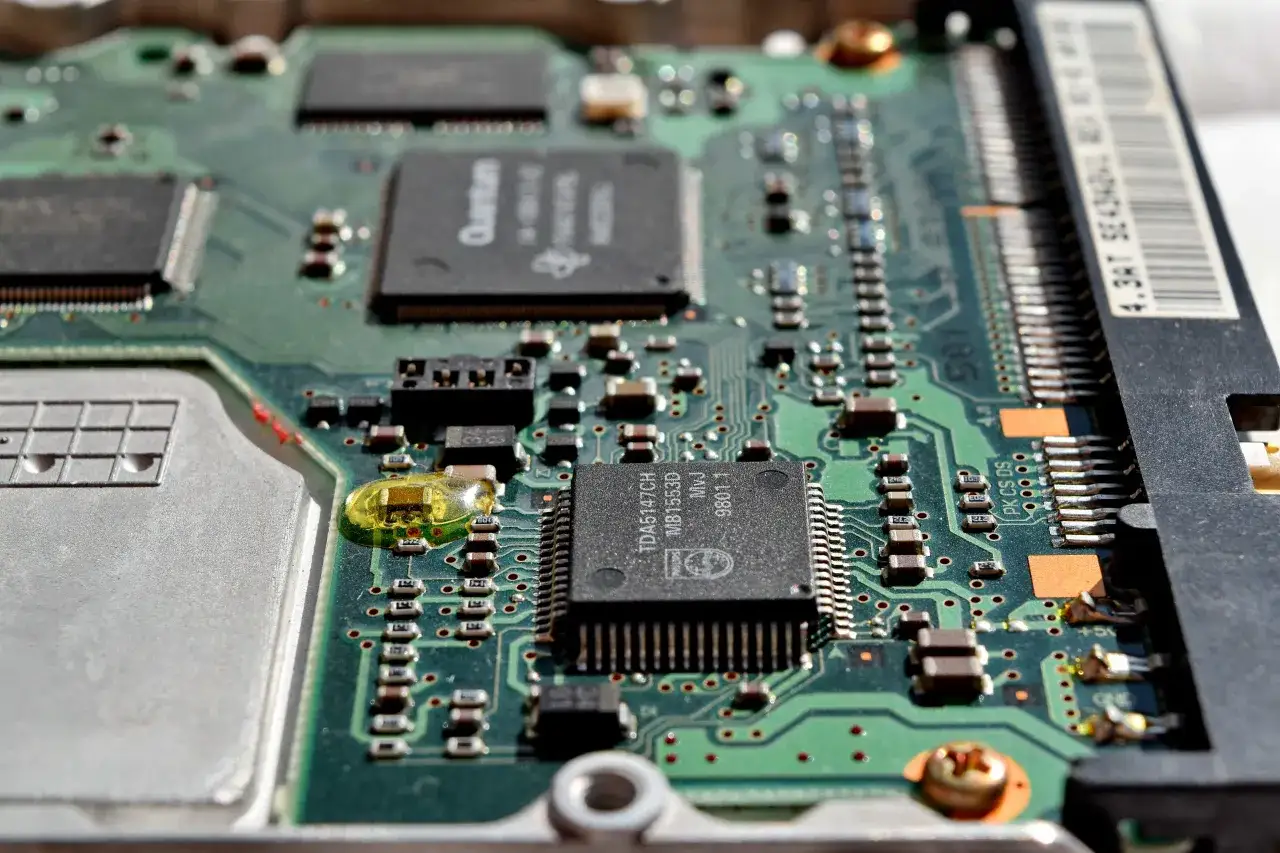

Rola tranzystora: miniaturowy przełącznik, który zmienił wszystko

Fizyczną realizacją idei bitu jest tranzystor. To miniaturowy, półprzewodnikowy przełącznik elektroniczny, który może być albo w stanie "włączonym" przepuszczając prąd elektryczny (stan 1), albo w stanie "wyłączonym" blokując przepływ prądu (stan 0). Miliardy, a nawet biliony takich tranzystorów, upakowanych w procesorach i układach pamięci, działają jak maleńkie bramki, które otwierają się i zamykają z niewyobrażalną prędkością. To właśnie ich zdolność do szybkiej zmiany stanu między 0 a 1 pozwala na przetwarzanie danych i wykonywanie wszystkich operacji, które obserwujemy w naszych cyfrowych urządzeniach.

Dlaczego system dziesiętny się nie sprawdził? Problem z zakłóceniami i złożonością

Można by zadać pytanie: dlaczego nie używać systemu dziesiętnego, który jest dla nas tak naturalny? Odpowiedź leży w fizyce i inżynierii. Reprezentowanie dziesięciu różnych cyfr (0-9) w elektronice wymagałoby dziesięciu precyzyjnie zdefiniowanych poziomów napięcia. Stworzenie układu, który niezawodnie rozróżniałby te wszystkie poziomy, byłoby niezwykle skomplikowane i kosztowne. Co więcej, taki system byłby bardzo podatny na błędy. Nawet niewielkie wahania napięcia, zakłócenia elektromagnetyczne czy zmiany temperatury mogłyby spowodować błędne odczytanie poziomu napięcia, a co za tym idzie błędne przetworzenie informacji. Prostota systemu binarnego eliminuje te problemy, oferując maksymalną niezawodność.

Jak zero-jedynkowo opisać cały świat, czyli reprezentacja danych w praktyce

Od liczb, które znamy, do kodu binarnego: prosta konwersja krok po kroku

Skoro komputer rozumie tylko zera i jedynki, jak przekształca nasze codzienne liczby dziesiętne na swój język? To prostsze, niż myślisz, i opiera się na potęgach liczby 2. Weźmy jako przykład liczbę dziesiętną 13. Aby zapisać ją binarnie, szukamy, jakie potęgi dwójki sumują się do 13:- Największa potęga dwójki mniejsza lub równa 13 to 2^3, czyli 8. Zatem mamy 1 (dla 8). Pozostaje nam 13 - 8 = 5.

- Następna potęga to 2^2, czyli 4. Mamy 1 (dla 4). Pozostaje nam 5 - 4 = 1.

- Kolejna potęga to 2^1, czyli 2. Nie mieści się w 1, więc mamy 0 (dla 2). Pozostaje nam 1.

- Ostatnia potęga to 2^0, czyli 1. Mamy 1 (dla 1). Pozostaje nam 1 - 1 = 0.

W ten sposób liczba dziesiętna 13 staje się binarnie 1101. Każda pozycja w liczbie binarnej odpowiada kolejnej potędze liczby 2 (od prawej do lewej: 2^0, 2^1, 2^2, 2^3 itd.). W naszym przykładzie daje to: (1 * 2^3) + (1 * 2^2) + (0 * 2^1) + (1 * 2^0) = (1 * 8) + (1 * 4) + (0 * 2) + (1 * 1) = 8 + 4 + 0 + 1 = 13.

Jak litery i znaki zamieniają się w bity? Tajemnica kodów ASCII i Unicode

Nie tylko liczby, ale i tekst musi zostać przetłumaczony na język binarny. Odbywa się to za pomocą standardów kodowania znaków, takich jak ASCII (American Standard Code for Information Interchange) czy nowocześniejszy Unicode. W uproszczeniu, każdemu znakowi, który widzisz na klawiaturze literze, cyfrze, symbolowi interpunkcyjnemu przypisany jest unikalny kod binarny. Na przykład, w kodzie ASCII, wielka litera "A" jest reprezentowana przez ciąg binarny 01000001. Kiedy piszesz na klawiaturze, komputer natychmiast zamienia naciśnięte klawisze na ich binarne odpowiedniki, które następnie przetwarza i wyświetla na ekranie.

Obraz wart tysiąca bitów: w jaki sposób komputer "widzi" kolory i kształty?

Obrazy cyfrowe, które oglądamy na ekranach, to nic innego jak ogromne zbiory danych binarnych. Każdy obraz składa się z maleńkich punktów, zwanych pikselami. Kolor każdego piksela jest opisany za pomocą liczb binarnych. W najpopularniejszym modelu RGB (Red, Green, Blue), intensywność składowych kolorów czerwonego, zielonego i niebieskiego jest reprezentowana przez wartości liczbowe, które oczywiście są następnie konwertowane na ciągi bitów. Im więcej bitów przeznaczymy na opis koloru piksela, tym więcej odcieni może on przyjąć, a obraz będzie bogatszy i bardziej realistyczny. Komputer "widzi" obraz jako siatkę pikseli, a każdy piksel to zestaw zer i jedynek opisujący jego barwę.

Krótka wzmianka o dźwięku i wideo: cyfrowa reprezentacja multimediów

Podobnie jak obrazy, dźwięk i wideo również muszą zostać zdigitalizowane. Dźwięk, który jest falą analogową, jest zamieniany na formę cyfrową poprzez proces "próbkowania". Polega to na mierzeniu amplitudy fali dźwiękowej w bardzo krótkich, regularnych odstępach czasu i zapisywaniu tych wartości jako liczb binarnych. Im częściej próbkuje się dźwięk i im więcej bitów używa się do opisania każdej próbki, tym wierniej cyfrowy zapis oddaje oryginalny dźwięk. Wideo to natomiast sekwencja wielu obrazów (klatek) wyświetlanych w krótkich odstępach czasu, z dołączoną zsynchronizowaną ścieżką dźwiękową wszystko to oczywiście zakodowane w zerach i jedynkach.

Jak komputer myśli i liczy używając tylko dwóch cyfr

Mózg operacji: czym są bramki logiczne (AND, OR, NOT)?

Sercem każdego procesora są bramki logiczne. To miniaturowe układy elektroniczne, zbudowane z tranzystorów, które wykonują podstawowe operacje logiczne na bitach, zgodnie z zasadami algebry Boole'a. Możemy myśleć o nich jak o bardzo prostych "decyzyjnych" elementach, które na podstawie jednego lub dwóch bitów wejściowych generują jeden bit wyjściowy. Oto trzy podstawowe typy bramek:

- Bramka AND (iloczyn logiczny): Zwraca 1 (prawdę) tylko wtedy, gdy oba bity wejściowe są równe 1. W każdym innym przypadku zwraca 0 (fałsz).

- Bramka OR (suma logiczna): Zwraca 1 (prawdę), gdy co najmniej jeden z bitów wejściowych jest równy 1. Zwraca 0 tylko wtedy, gdy oba bity wejściowe to 0.

- Bramka NOT (negacja): Jest to bramka z jednym wejściem, która po prostu odwraca wartość bitu wejściowego. Jeśli wejściem jest 1, wyjściem jest 0, i odwrotnie.

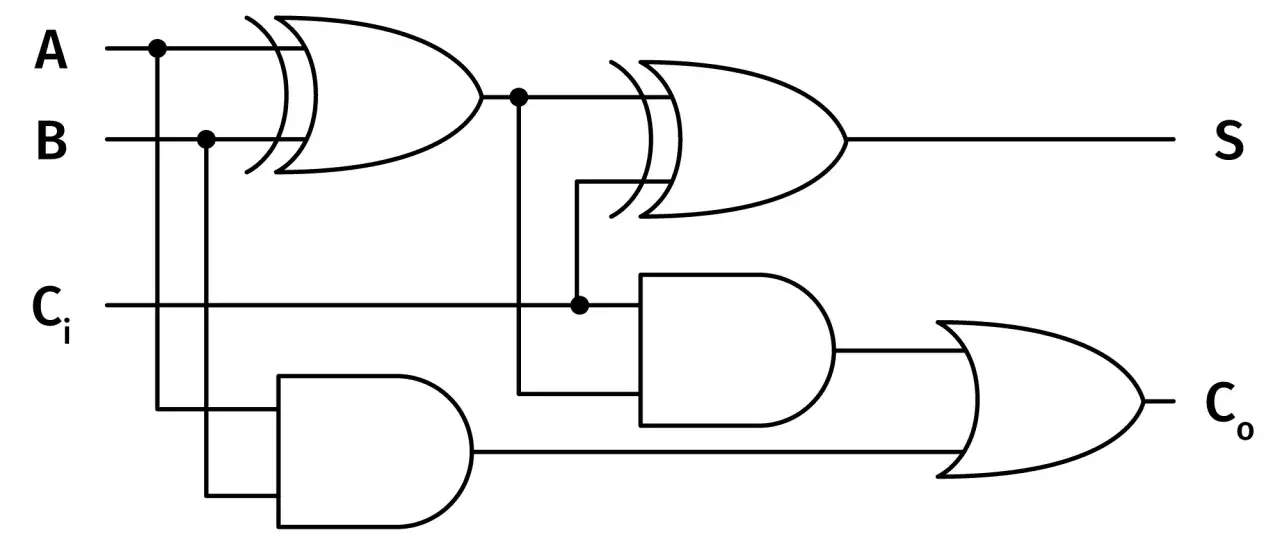

Od prostych operacji do złożonych obliczeń: jak procesor dodaje liczby binarne?

Łącząc ze sobą te proste bramki logiczne w bardziej złożone układy, inżynierowie tworzą komponenty zdolne do wykonywania skomplikowanych operacji. Przykładem są tzw. sumatory, które potrafią dodawać liczby binarne. To właśnie w ten sposób procesor wykonuje wszystkie operacje arytmetyczne. Co ciekawe, nawet odejmowanie, mnożenie czy dzielenie sprowadzają się w gruncie rzeczy do serii operacji dodawania i przesuwania bitów. Cała potęga obliczeniowa komputera, od prostego kalkulatora po zaawansowane symulacje, opiera się na niewyobrażalnie szybkiej sekwencji tych elementarnych operacji na zerach i jedynkach.

Zrozumieć kod maszynowy: czym są instrukcje, które wykonuje Twój procesor?

Kiedy mówimy o tym, jak komputer "myśli", dochodzimy do pojęcia kodu maszynowego. Jest to język najniższego poziomu, który jest bezpośrednio zrozumiały dla procesora. W przeciwieństwie do systemu binarnego, który jest sposobem zapisu liczb, kod maszynowy to konkretne sekwencje bitów (instrukcje), które mówią procesorowi, jaką operację ma wykonać. Na przykład, jedna sekwencja bitów może oznaczać "dodaj dwie liczby", inna "zapisz dane w pamięci", a jeszcze inna "przeskocz do innej części programu". Procesor odczytuje te binarne instrukcje i wykonuje je w błyskawicznym tempie, realizując w ten sposób programy i aplikacje, z których korzystamy na co dzień.

System binarny to nie wszystko, czyli dlaczego programiści używają systemu szesnastkowego

Przeczytaj również: Co to jest system binarny? Zrozum język komputerów od podstaw

Krótszy zapis, ta sama informacja: jak system heksadecymalny ułatwia pracę z kodem

Chociaż komputery posługują się wyłącznie systemem binarnym, dla człowieka długie ciągi zer i jedynek są mało czytelne i podatne na błędy. Dlatego programiści, zwłaszcza ci pracujący na niskim poziomie abstrakcji (np. z pamięcią czy rejestrami procesora), często posługują się systemem szesnastkowym (heksadecymalnym). Jest to system o podstawie 16, używający cyfr 0-9 i liter A-F. Jego główna zaleta polega na tym, że jedna cyfra szesnastkowa odpowiada dokładnie czterem bitom binarnym. Dzięki temu, długi ciąg binarny, na przykład 1111000010101111, można znacznie zwięźlej zapisać jako F0AF w systemie szesnastkowym. To ułatwia analizę i debugowanie kodu, czyniąc go bardziej przystępnym dla ludzkiego oka, bez utraty informacji.

Potęga prostoty, czyli jak zera i jedynki napędzają współczesny świat

Jak widać, system binarny, mimo swojej fundamentalnej prostoty, jest absolutnym fundamentem całej cyfrowej rewolucji, której jesteśmy świadkami. Od pojedynczego, miniaturowego przełącznika tranzystora i dwóch jego stanów (0 lub 1), zbudowany jest cały skomplikowany świat oprogramowania, internetu, sztucznej inteligencji i wszystkich innych technologii, które kształtują nasze życie. To właśnie ta niezawodna, binarna podstawa pozwala na tworzenie systemów o niewyobrażalnej złożoności i szybkości. Potęga technologii cyfrowej leży w jej niezwykle prostych i niezawodnych podstawach, które, jak mam nadzieję, teraz rozumiesz nieco lepiej.