Pytanie, czy liczba binarna może zaczynać się od zera, wydaje się proste, ale jego odpowiedź jest znacznie bardziej złożona, niż mogłoby się wydawać na pierwszy rzut oka. Jak się przekonamy, zależy ona od kontekstu czy patrzymy na problem z perspektywy czystej matematyki, czy też z punktu widzenia informatyki, gdzie ten z pozoru nieistotny detal ma fundamentalne znaczenie dla działania komputerów.

Wiodące zero w liczbie binarnej ma kluczowe znaczenie zwłaszcza w informatyce

- Z matematycznego punktu widzenia wiodące zera nie zmieniają wartości liczby (np. 0101 to to samo co 101).

- W informatyce zera na początku są niezbędne do zachowania stałej długości danych, np. 8-bitowego bajta (liczba 5 to 00000101).

- W kodowaniu liczb ze znakiem (U2), skrajne lewe zero oznacza, że liczba jest dodatnia, a jedynka, że jest ujemna.

- Zera wiodące są też integralną częścią standardów kodowania znaków (ASCII/Unicode), kolorów (RGB) i operacji niskopoziomowych.

Czy liczba binarna może zaczynać się od zera? Tak, ale kontekst jest kluczowy

Zero z przodu w matematyce: dlaczego nic nie zmienia?

Z czysto matematycznego punktu widzenia, wiodące zera w liczbie binarnej (podobnie jak w dziesiętnej) nie mają wpływu na jej wartość. Liczba binarna 101 reprezentuje wartość dziesiętną 5. Jeśli dodamy z przodu jedno zero, otrzymamy 0101, co wciąż jest 5. Podobnie 00101 to również 5. Dzieje się tak, ponieważ pozycja cyfry określa jej wagę (potęgę podstawy systemu liczbowego), a zero na pozycji o wyższej wadze po prostu nie dodaje nic do sumy. Matematyka skupia się na abstrakcyjnej wartości, a nie na konkretnej reprezentacji.

Informatyka kontra matematyka: Dwa różne spojrzenia na to samo zero

Tutaj zaczyna się sedno problemu i to, co czyni to pytanie tak interesującym. O ile matematyka pozwala nam swobodnie operować na abstrakcyjnych wartościach, o tyle informatyka musi radzić sobie z fizyczną reprezentacją tych wartości w pamięci komputera, rejestrach procesora czy podczas transmisji danych. Komputery nie są "inteligentne" w ludzkim sensie; muszą mieć jasno określone reguły, jak interpretować ciągi bitów. Właśnie ta "fizyczność" zapisu sprawia, że wiodące zera, które w matematyce są ignorowane, w świecie cyfrowym stają się często kluczowe i niosą ze sobą konkretne informacje.

Dlaczego komputery potrzebują zer na początku liczby?

Koncepcja "słowa maszynowego": Dlaczego komputery kochają stałą długość zapisu?

Komputery przetwarzają dane w ściśle określonych blokach, zwanych "słowami maszynowymi" (ang. *machine word*). Najpopularniejsze jednostki to bajty (8 bitów), ale mamy też słowa (16 bitów), podwójne słowa (32 bity) czy poczwórne słowa (64 bity). Aby zapewnić spójność i efektywność operacji, każda liczba, niezależnie od jej faktycznej wartości, musi zajmować całą, z góry określoną długość. Jeśli liczba jest "za krótka", czyli wymaga mniej bitów niż dostępna przestrzeń, jest ona dopełniana zerami z lewej strony, aż do osiągnięcia wymaganej długości. Jest to absolutnie niezbędne, aby procesor wiedział, gdzie kończy się jedna liczba, a zaczyna druga, i mógł wykonywać na nich operacje w jednolity sposób.

Przykład praktyczny: Ta sama liczba 5 w zapisie 4-bitowym, 8-bitowym i 16-bitowym

Aby lepiej to zrozumieć, spójrzmy na prosty przykład liczby dziesiętnej 5, która w czystej postaci binarnej to 101:

- Zapis 4-bitowy:

0101 - Zapis 8-bitowy (bajt):

00000101 - Zapis 16-bitowy (słowo):

0000000000000101

Jak widać, wartość liczby się nie zmienia, ale jej reprezentacja w pamięci komputera musi być dostosowana do stałej długości. Te wiodące zera są tutaj integralną częścią zapisu, a nie zbędnym dodatkiem.

Jak zera wiodące pomagają w adresowaniu pamięci i porządkowaniu danych?

Ujednolicona długość danych, osiągana dzięki dopełnianiu zerami, ma ogromne znaczenie dla wydajności. Upraszcza to znacząco operacje arytmetyczne wykonywane przez procesor, ponieważ zawsze pracuje on na blokach o tej samej wielkości. Co więcej, ułatwia to obliczanie adresów w pamięci komputera. Wyobraźmy sobie, że procesor musi odczytać dziesiątą liczbę z bloku pamięci jeśli każda liczba ma stałą długość, obliczenie jej adresu jest trywialne. Bez tego, adresowanie byłoby znacznie bardziej skomplikowane i wolniejsze.

Jak zero na początku zmienia wszystko? Poznaj kod uzupełnień do dwóch (U2)

Wprowadzenie do kodu uzupełnień do dwóch (U2) standardu zapisu liczb ze znakiem

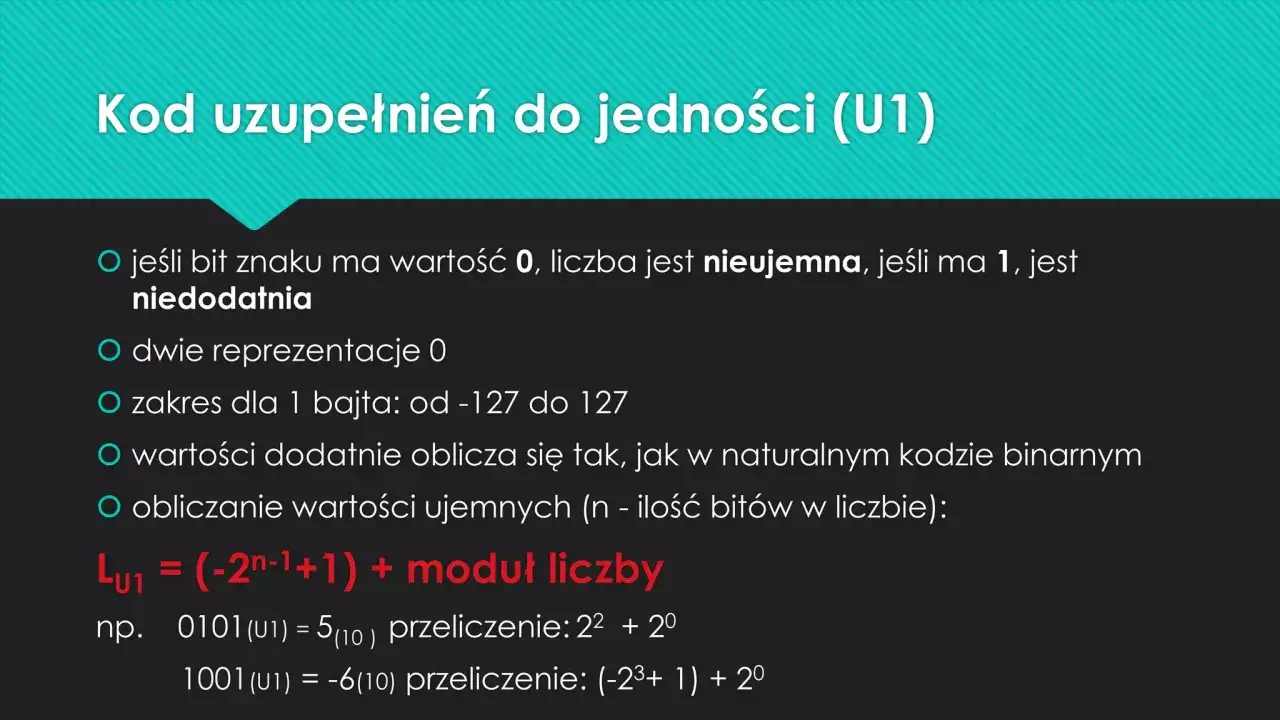

Jednym z najważniejszych kontekstów, w którym wiodące zero ma fundamentalne znaczenie, jest kod uzupełnień do dwóch (ang. *two's complement*), powszechnie stosowany w komputerach do zapisu liczb całkowitych ze znakiem (czyli zarówno dodatnich, jak i ujemnych). Jego popularność wynika z tego, że znacznie upraszcza operacje arytmetyczne (dodawanie i odejmowanie liczb dodatnich i ujemnych można realizować za pomocą tego samego obwodu) i ma tylko jedną reprezentację zera (w przeciwieństwie do kodu znak-moduł, gdzie +0 i -0 byłyby różne).

Bit znaku: Kiedy skrajne lewe zero oznacza "plus", a jedynka "minus"?

W kodzie uzupełnień do dwóch kluczową rolę odgrywa najbardziej znaczący bit (MSB *Most Significant Bit*), czyli ten skrajnie po lewej. To on pełni funkcję "bitu znaku". Jeśli ten bit to 0, liczba jest dodatnia lub zerem. Jeśli ten bit to 1, liczba jest ujemna. W tym kontekście, wiodące zero dla liczby dodatniej nie jest tylko dopełnieniem jest kluczową informacją o jej znaku. Bez niego komputer nie byłby w stanie odróżnić liczby dodatniej od ujemnej.

Różnica między 0111 a 1111 w systemie 4-bitowym: przykład, który wszystko wyjaśnia

Przyjrzyjmy się temu na konkretnym przykładzie w 4-bitowym systemie U2:

Liczba 0111: Skrajny lewy bit to 0, co od razu mówi nam, że jest to liczba dodatnia. Pozostałe bity (111) reprezentują wartość 7. Zatem 0111 to +7.

Liczba 1111: Skrajny lewy bit to 1, co oznacza, że mamy do czynienia z liczbą ujemną. Aby obliczyć jej wartość, należy odwrócić wszystkie bity (0000 -> 0001) i dodać 1, co daje 0001. To jest reprezentacja wartości bezwzględnej (1), ale jako że bit znaku to 1, oznacza to -1.

Ten przykład dobitnie pokazuje, jak skrajny lewy bit czy to zero, czy jedynka diametralnie zmienia interpretację wartości całej liczby w kodzie U2. Wiodące zero jest tu absolutnie niezbędne do prawidłowego odczytania wartości.

Gdzie jeszcze w cyfrowym świecie spotkasz kluczowe zera?

Reprezentacja kolorów RGB (np. #00FF00): zero jako fundament koloru

Wiodące zera są również kluczowe w zapisie heksadecymalnym, często używanym do reprezentacji kolorów, na przykład w projektowaniu stron internetowych (CSS). Kolor zielony często jest zapisywany jako #00FF00. Każda para cyfr szesnastkowych reprezentuje intensywność jednej ze składowych koloru (czerwonej, zielonej, niebieskiej). W tym przypadku 00 dla składowej czerwonej i 00 dla niebieskiej są niezbędne, aby zachować stałą, 6-znakową strukturę zapisu. Te zera jednoznacznie określają zerową intensywność tych składowych, co jest kluczowe dla uzyskania pożądanego koloru.

Kodowanie znaków ASCII i Unicode: Każdy znak to pełen zestaw bitów

W standardach kodowania znaków, takich jak ASCII czy Unicode (np. UTF-8), każdy symbol, litera czy cyfra ma przypisany unikalny kod binarny o stałej długości. Na przykład, w standardzie ASCII, znak spacji ma kod dziesiętny 32, co binarnie w 8-bitowym bajcie zapisuje się jako 00100000. W tym przypadku wiodące zera są integralną częścią kodu znaku i nie mogą być pominięte. Każdy bit ma swoje znaczenie w kontekście identyfikacji konkretnego symbolu.

Maski bitowe i operacje logiczne w programowaniu niskopoziomowym

W programowaniu niskopoziomowym, zwłaszcza podczas pracy z rejestrami sprzętowymi czy flagami, programiści często używają masek bitowych. Są to specjalne liczby binarne, które służą do precyzyjnego wyizolowania, ustawienia lub wyczyszczenia konkretnych bitów w większym słowie maszynowym za pomocą operacji logicznych (AND, OR, XOR). Wiodące zera w masce bitowej są absolutnie niezbędne, aby zapewnić, że operacja wpłynie tylko na zamierzone bity, a pozostałe pozostaną niezmienione. Bez nich maski byłyby niekompletne i mogłyby prowadzić do nieprzewidzianych błędów.Podsumowanie: kiedy zero z przodu ma znaczenie?

Zestawienie: Wartość matematyczna a reprezentacja w pamięci komputera

Podsumowując, znaczenie wiodących zer w liczbach binarnych jest silnie zależne od kontekstu:

| Kontekst | Znaczenie wiodącego zera |

|---|---|

| Matematyka | Brak znaczenia dla wartości liczby. Zera są pomijane. |

| Informatyka (reprezentacja danych) | Kluczowe znaczenie: dopełnienie do stałej długości słowa maszynowego, bit znaku w kodzie U2, integralna część kodu znaku/koloru, maski bitowe. |

Przeczytaj również: Jak zamienić liczbę na binarny? Odkryj sekret działania komputerów

Kluczowy wniosek dla każdego programisty i pasjonata technologii

Dla każdego, kto pracuje z technologią, zrozumienie różnicy między abstrakcyjną wartością liczby a jej fizyczną reprezentacją w pamięci komputera jest absolutnie fundamentalne. Wiodące zera, choć często ignorowane w matematyce, w świecie cyfrowym pełnią szereg kluczowych funkcji, które umożliwiają komputerom efektywne przetwarzanie i przechowywanie danych. To sedno tego, jak działają komputery, i klucz do pisania poprawnego, wydajnego kodu.