System binarny to język komputerów oparty na 0 i 1 poznaj jego podstawy

- System binarny (dwójkowy) to system liczbowy, który używa tylko dwóch cyfr: 0 i 1.

- Jest fundamentem informatyki, ponieważ stany 0 i 1 idealnie odpowiadają fizycznym stanom w elektronice (np. brak prądu / prąd płynie).

- Wszystkie dane w komputerze tekst, obrazy, dźwięk, programy są zapisywane jako długie ciągi zer i jedynek.

- Najmniejsza jednostka informacji to bit (pojedyncze 0 lub 1), a osiem bitów tworzy bajt, czyli standardową jednostkę pamięci.

Dlaczego komputery używają tylko zer i jedynek, czyli wprowadzenie do języka maszyn

Świat w dwóch stanach, czyli prostota, która napędza technologię

Zastanawiałeś się kiedyś, dlaczego komputery, mimo swojej złożoności, opierają się na tak prostym systemie jak binarny? Odpowiedź jest zaskakująco prosta i leży u podstaw elektroniki. System dwójkowy jest tak użyteczny, ponieważ idealnie odwzorowuje dwa stabilne stany fizyczne w układach elektronicznych. Możemy myśleć o nich jako o "włączony" (reprezentowane przez 1) i "wyłączony" (reprezentowane przez 0), albo "prąd płynie" (1) i "brak prądu" (0). Ta dychotomia, ta prostota, zapewnia ogromną niezawodność i minimalizuje błędy w przetwarzaniu danych. Wyobraź sobie, jak trudno byłoby rozróżnić dziesięć różnych poziomów napięcia w obwodzie, aby reprezentować cyfry od 0 do 9, w porównaniu do zaledwie dwóch stanów. To właśnie ta binarna natura sprawia, że komputery są tak szybkie i precyzyjne.

Od Leibniza do laptopa, czyli krótka historia zer i jedynek

Choć system dwójkowy wydaje się być wynalazkiem ery cyfrowej, jego korzenie sięgają znacznie głębiej. Idea systemu dwójkowego była znana już w starożytnych Chinach, ale to Gottfried Wilhelm Leibniz, wybitny niemiecki filozof i matematyk, w 1703 roku formalnie opisał jego zasady w swoim artykule "Explication de l'Arithmétique Binaire". Leibniz, zafascynowany prostotą i elegancją tego systemu, nie zdawał sobie zapewne sprawy, że kładzie teoretyczne podwaliny pod technologię, która wieki później zrewolucjonizuje świat. To właśnie jego prace otworzyły drogę do zastosowania systemu binarnego w pierwszych maszynach liczących, a ostatecznie w dzisiejszych laptopach, smartfonach i superkomputerach.

Czym jest system binarny i jakie są jego najprostsze zasady

Bit i bajt, czyli podstawowe klocki cyfrowego świata

Kiedy mówimy o systemie binarnym, musimy zacząć od jego najmniejszych elementów. Najmniejszą jednostką informacji w tym systemie jest bit. Bit to nic innego jak pojedyncza cyfra binarna, która może przyjąć wartość 0 lub 1. Wyobraź sobie bit jako pojedynczy przełącznik, który może być albo włączony, albo wyłączony. To z tych maleńkich przełączników budujemy cały cyfrowy wszechświat. Idąc dalej, osiem bitów tworzy bajt. Bajt to podstawowa jednostka danych w informatyce, którą można porównać do pojedynczego "słowa" w języku komputerów. To właśnie bajty mierzą rozmiar plików, pamięci RAM czy pojemność dysków twardych. Wszystko, co widzisz na ekranie, słyszysz z głośników czy czytasz w tekście, jest ostatecznie reprezentowane jako kombinacje bitów i bajtów.

Zasada pozycyjna w praktyce, czyli jak odczytać liczbę binarną

System binarny, podobnie jak nasz codzienny system dziesiętny, jest systemem pozycyjnym. Oznacza to, że wartość cyfry zależy od jej miejsca w liczbie. Różnica polega na tym, że w systemie dziesiętnym pozycje odpowiadają potęgom liczby 10 (jedności, dziesiątki, setki itd.), natomiast w systemie binarnym pozycje odpowiadają kolejnym potęgom liczby 2. Spójrzmy na przykład. Liczba binarna `1010` nie oznacza "tysiąc dziesięć" w naszym rozumieniu. Aby ją odczytać, rozkładamy ją na potęgi dwójki, zaczynając od prawej strony (od 2 do potęgi 0):

- `0` * 2^0 (czyli 0 * 1 = 0)

- `1` * 2^1 (czyli 1 * 2 = 2)

- `0` * 2^2 (czyli 0 * 4 = 0)

- `1` * 2^3 (czyli 1 * 8 = 8)

Sumując te wartości (0 + 2 + 0 + 8), otrzymujemy 10. Zatem binarna liczba `1010` to dziesiętna liczba 10. To właśnie ta zasada pozwala komputerom interpretować ciągi zer i jedynek jako konkretne wartości liczbowe.

Jak mówić po binarnemu, czyli praktyczny przewodnik po zamianie liczb

Zamiana z systemu dziesiętnego na binarny, czyli jak przetłumaczyć nasze liczby na język komputera

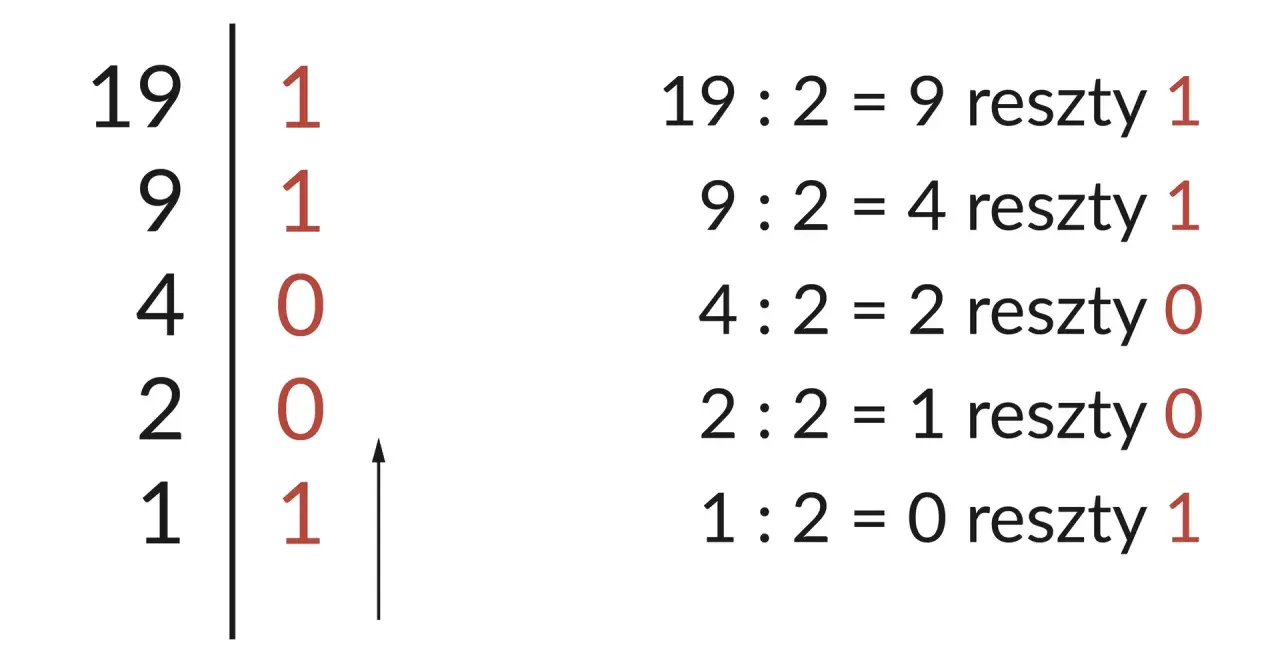

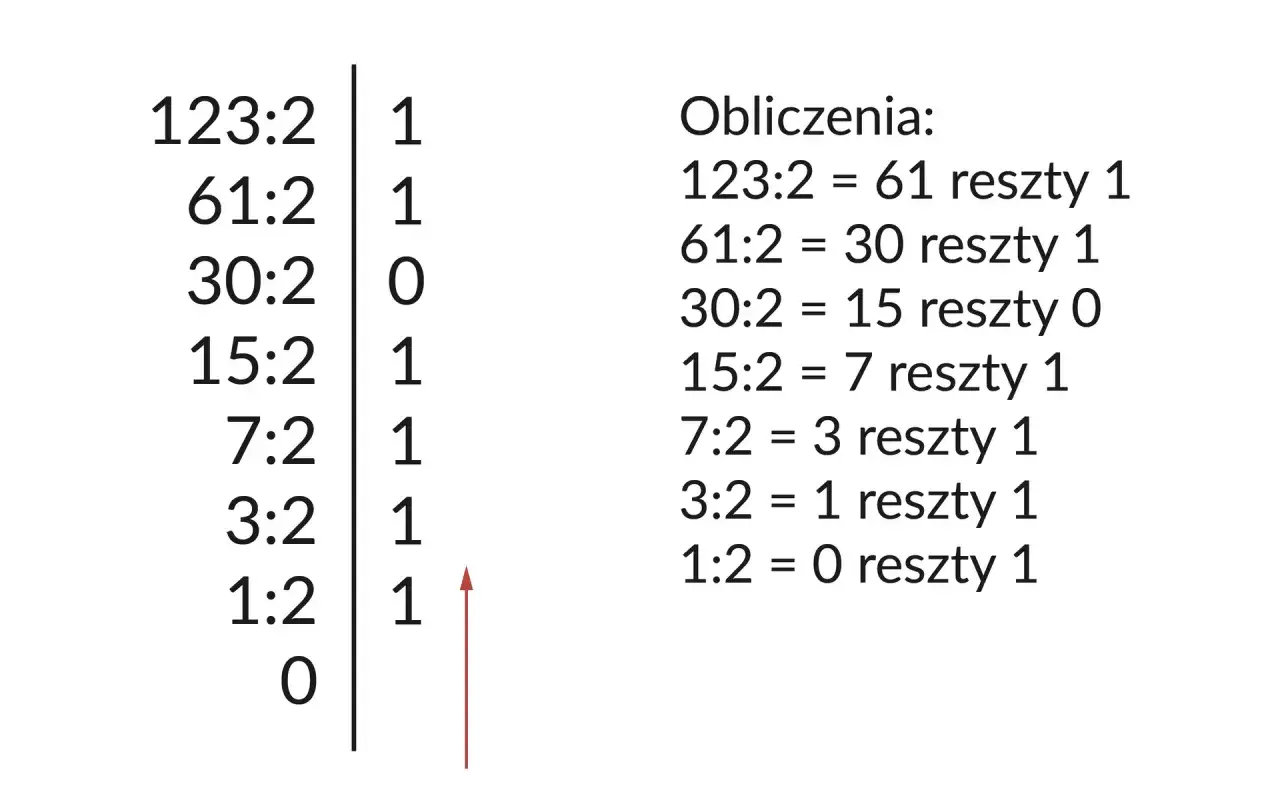

Jedną z podstawowych umiejętności w zrozumieniu systemu binarnego jest umiejętność konwersji liczb. Najpopularniejszą metodą zamiany liczby dziesiętnej na binarną jest wielokrotne dzielenie przez 2 i spisywanie reszt. Zobaczmy to na przykładzie liczby 29:

- Dzielimy 29 przez 2: 29 / 2 = 14 reszty 1

- Dzielimy 14 przez 2: 14 / 2 = 7 reszty 0

- Dzielimy 7 przez 2: 7 / 2 = 3 reszty 1

- Dzielimy 3 przez 2: 3 / 2 = 1 reszty 1

- Dzielimy 1 przez 2: 1 / 2 = 0 reszty 1

Teraz wystarczy spisać reszty od dołu do góry. Otrzymujemy liczbę binarną: `11101`. To właśnie jest binarna reprezentacja dziesiętnej liczby 29.

Jak komputer odczytuje zera i jedynki, czyli powrót do systemu dziesiętnego

Proces odwrotny, czyli zamiana liczby binarnej na dziesiętną, jest równie prosty i opiera się na zasadzie pozycyjnej, którą już poznaliśmy. Weźmy naszą liczbę binarną `11101` i zamieńmy ją z powrotem na dziesiętną. Przypisujemy każdej cyfrze potęgę dwójki, zaczynając od prawej strony (2^0):

1 * 2^4 + 1 * 2^3 + 1 * 2^2 + 0 * 2^1 + 1 * 2^0

1 * 16 + 1 * 8 + 1 * 4 + 0 * 2 + 1 * 1

16 + 8 + 4 + 0 + 1 = 29

Jak widać, konwersja w drugą stronę daje nam dokładnie ten sam wynik. To pokazuje, jak spójny i logiczny jest system binarny, umożliwiając precyzyjne przekładanie danych między różnymi formami.

A co z literami i znakami, czyli binarny alfabet

System binarny koduje nie tylko liczby. Każda litera, cyfra, symbol czy znak interpunkcyjny, który widzisz na ekranie, ma swoją binarną reprezentację. Dzieje się tak dzięki standardom kodowania znaków, takim jak popularne ASCII (American Standard Code for Information Interchange) czy bardziej rozbudowany Unicode. Te standardy przypisują każdemu znakowi unikalny kod binarny, dzięki czemu komputery na całym świecie mogą poprawnie wyświetlać i przetwarzać tekst. Bez nich komunikacja cyfrowa byłaby niemożliwa. Spójrz na kilka przykładów:

| Znak | Kod binarny ASCII |

|---|---|

| A | 01000001 |

| B | 01000010 |

| a | 01100001 |

| ! | 00100001 |

| ? | 00111111 |

Arytmetyka dla maszyn, czyli czy dodawanie zer i jedynek jest trudne

Jak dodać 1+1, żeby wyszło 10, czyli podstawy binarnego dodawania

Arytmetyka w systemie binarnym, choć na pierwszy rzut oka może wydawać się obca, opiera się na bardzo prostych zasadach. Procesor komputera wykonuje miliony takich operacji na sekundę. Oto cztery podstawowe zasady dodawania binarnego:

- 0 + 0 = 0

- 0 + 1 = 1

- 1 + 0 = 1

- 1 + 1 = 0 i 1 w przeniesieniu (czyli w sumie 10 w zapisie binarnym)

Ostatnia zasada jest kluczowa i przypomina dodawanie w systemie dziesiętnym, gdy suma przekracza 9 (np. 5+5=0 i 1 w przeniesieniu, co daje 10). W systemie binarnym, gdy suma dwóch jedynek przekracza wartość maksymalną dla pojedynczego bitu (czyli 1), również następuje przeniesienie do kolejnej pozycji. Zobaczmy to na przykładzie dodawania dwóch liczb: 5 (binarnie 101) i 3 (binarnie 011):

101 (5) + 011 (3) ----- 1000 (8)

Zaczynamy od prawej: 1+1 daje 0 i 1 w przeniesieniu. Następnie 0+1 plus przeniesione 1 daje 0 i 1 w przeniesieniu. Na koniec 1+0 plus przeniesione 1 daje 0 i 1 w przeniesieniu. Wynik to 1000, co w systemie dziesiętnym faktycznie daje 8. To właśnie w ten sposób komputery wykonują podstawowe operacje matematyczne.

Krótkie spojrzenie na odejmowanie i mnożenie, czyli fundament wszystkich obliczeń

Podobnie jak dodawanie, również odejmowanie, mnożenie i dzielenie w systemie binarnym opierają się na zestawie prostych reguł, które procesor komputera potrafi błyskawicznie wykonać. Nie będę wchodził w szczegóły tych operacji, ale ważne jest, aby zrozumieć, że wszystkie złożone obliczenia, od symulacji fizycznych po renderowanie grafiki 3D, są ostatecznie rozkładane na te elementarne operacje na zerach i jedynkach. To właśnie te proste zasady są podstawą całej arytmetyki wykonywanej przez każdy komputer.

Gdzie system binarny ukrywa się na co dzień i jakie ma zastosowania

Od selfie w telefonie po ulubiony serial, czyli binarna magia multimediów

System binarny jest wszechobecny w naszym cyfrowym życiu, nawet jeśli tego nie zauważamy. Kiedy robisz selfie telefonem, aparat cyfrowy przetwarza światło na sygnały elektryczne, a następnie na ciągi zer i jedynek. Każde zdjęcie cyfrowe to nic innego jak ogromna siatka maleńkich punktów, czyli pikseli. Kolor i jasność każdego piksela są zapisywane jako liczby binarne. Im więcej bitów przeznaczymy na opis koloru, tym więcej odcieni może on przyjąć, a zdjęcie staje się bardziej szczegółowe i realistyczne. Podobnie jest z filmami. Kiedy oglądasz ulubiony serial na platformie streamingowej, Twój komputer lub smartfon odbiera strumień danych binarnych, które reprezentują kolejne klatki obrazu i dźwięk. Te zera i jedynki są błyskawicznie dekodowane i przekształcane z powrotem w to, co widzisz i słyszysz.

Jak muzyka z płyty CD i pliku MP3, czyli digitalizacja dźwięku

Proces digitalizacji dźwięku to kolejny doskonały przykład zastosowania systemu binarnego. Analogowa fala dźwiękowa, którą słyszymy, jest ciągła i zmienna. Aby zapisać ją cyfrowo, musi zostać "spróbkowana". Oznacza to, że tysiące razy na sekundę mierzy się jej wysokość (amplitudę), a wartość każdej próbki jest następnie zapisywana jako liczba binarna. Im więcej próbek na sekundę i im więcej bitów na próbkę, tym wierniej cyfrowy zapis oddaje oryginalny dźwięk. Niezależnie od tego, czy słuchasz muzyki z płyty CD, czy pliku MP3, zawsze masz do czynienia z długimi ciągami zer i jedynek, które Twój odtwarzacz przekształca z powrotem w analogowe wibracje powietrza, które odbierasz jako muzykę.

Czy istnieją alternatywy dla systemu binarnego, czyli system szesnastkowy i przyszłość obliczeń

Dlaczego programiści czasem wolą system szesnastkowy, czyli binarny skrót

Mimo że komputery pracują na systemie binarnym, programiści i inżynierowie często posługują się innym systemem liczbowym: szesnastkowym (heksadecymalnym). Dlaczego? Ponieważ długie ciągi zer i jedynek są mało czytelne dla człowieka. System szesnastkowy, używający 16 cyfr (0-9 i A-F), jest dla nas znacznie łatwiejszy do odczytania i zapisu, a jednocześnie stanowi idealny "skrót" dla zapisu binarnego. Dzieje się tak, ponieważ jedna cyfra szesnastkowa zawsze odpowiada dokładnie czterem bitom. Na przykład, binarna liczba `10110101` jest długa i trudna do zapamiętania. W systemie szesnastkowym staje się ona po prostu `B5`. To znacznie krótszy i czytelniejszy zapis, który ułatwia pracę z danymi na niskim poziomie, np. podczas debugowania programów czy analizy pamięci.

Przeczytaj również: Jak przeliczyć binarny na dziesiętny? Zrozum język komputerów!

Krótko o przyszłości: Czy komputery kwantowe porzucą system binarny?

W obliczu dynamicznego rozwoju technologii, naturalne jest pytanie o przyszłość. Czy system binarny, który tak dobrze służył nam przez dziesięciolecia, zostanie kiedyś zastąpiony? Odpowiedź może leżeć w komputerach kwantowych. Zamiast klasycznych bitów, które mogą być tylko 0 lub 1, komputery kwantowe używają kubitów. Kubit to fascynująca jednostka, która dzięki zasadom mechaniki kwantowej może reprezentować 0, 1, lub oba te stany jednocześnie (tzw. superpozycja). To otwiera zupełnie nowe możliwości obliczeniowe, pozwalając na rozwiązywanie problemów, które są poza zasięgiem nawet najpotężniejszych superkomputerów binarnych. Choć technologia kwantowa jest wciąż w powijakach, zwiastuje ona potencjalną przyszłość obliczeń, która wykracza poza klasyczny system binarny, wprowadzając nas w erę jeszcze bardziej złożonych i wydajnych maszyn.